观韬视点 | 一文浅析用户部署或使用DeepSeek等大模型AI需要注意的法律问题

作者:李嘉颖 徐荣元

前言:据《北京日报》消息,广东、江苏等多地的政务服务系统宣布接入DeepSeek系列大模型,同时,三大电信运营商,以及百度、腾讯等互联网巨头也纷纷与DeepSeek展开合作。各大高校也积极进行本地化部署,例如浙江大学推出的DeepSeek-v3+多个智能体应用的“浙大先生”。从问世以来,DeepSeek基于其创新的算法和卓越的性价比受到业内广泛追捧,它不仅提升了算力资源的利用效率,更为国产芯片的发展开辟了新的道路,助力行业朝着高效和绿色的方向发展[1]。然而,用户在本地化部署与日常使用AI大模型时并非是没有风险的。

2025年2月28日,我们在本所公众号刊发了《观韬视点|一文详解DeepSeek等大模型AI生成内容相关著作权法律问题及案例》,大家的反响还不错,本文作为前文的续作,将从备案与安全评估、数据安全与隐私泄露、知识产权、法律责任四个方面浅析AI大模型部署或使用过程中可能遇到的法律问题。

一、备案与安全评估

鉴于生成式人工智能在数据集运用和生成虚假性内容等方面存在的风险,国家已出台一系列法律文件以规范其在市场中的运作。对于具有舆论属性或者社会动员能力的深度合成服务提供者,包括生成式人工智能服务提供者,需根据《互联网信息服务算法推荐管理规定》履行算法备案和变更、注销备案手续,并根据相关要求进行安全评估。

根据《具有舆论属性或社会动员能力的互联网信息服务安全评估规定》第二条,具有舆论属性或社会动员能力的互联网信息服务,包括下列情形:(1)开办论坛、博客、微博客、聊天室、通讯群组、公众账号、短视频、网络直播、信息分享、小程序等信息服务或者附设相应功能;(2)开办提供公众舆论表达渠道或者具有发动社会公众从事特定活动能力的其他互联网信息服务。

表1 生成式人工智能备案相关法律规定

名称 | 规定 |

《生成式人工智能服务管理暂行办法》 | 第十七条 提供具有舆论属性或者社会动员能力的生成式人工智能服务的,应当按照国家有关规定开展安全评估,并按照《互联网信息服务算法推荐管理规定》履行算法备案和变更、注销备案手续。

|

《互联网信息服务深度合成管理规定》 | 第十九条 具有舆论属性或者社会动员能力的深度合成服务提供者,应当按照《互联网信息服务算法推荐管理规定》履行备案和变更、注销备案手续。 深度合成服务技术支持者应当参照前款规定履行备案和变更、注销备案手续。 完成备案的深度合成服务提供者和技术支持者应当在其对外提供服务的网站、应用程序等的显著位置标明其备案编号并提供公示信息链接。

|

《互联网信息服务算法推荐管理规定》 | 第二十四条 具有舆论属性或者社会动员能力的算法推荐服务提供者应当在提供服务之日起十个工作日内通过互联网信息服务算法备案系统填报服务提供者的名称、服务形式、应用领域、算法类型、算法自评估报告、拟公示内容等信息,履行备案手续。 算法推荐服务提供者的备案信息发生变更的,应当在变更之日起十个工作日内办理变更手续。 算法推荐服务提供者终止服务的,应当在终止服务之日起二十个工作日内办理注销备案手续,并作出妥善安排。

第二十六条 完成备案的算法推荐服务提供者应当在其对外提供服务的网站、应用程序等的显著位置标明其备案编号并提供公示信息链接。 |

对于未按规定进行备案的生成式人工智能服务提供者,将依法依规受到处罚。例如,2024年上半年,重庆网信主管部门在查处的违规行为中,发现“灵象智问AI”“重庆哨兵拓展迷”等网站未经安全测评备案、违规提供生成式人工智能服务问题,依法对相关运营主体开展执法约谈,责令立即停止相关服务;发现“南川区蓉城网络科技工作室”未经安全评估上线提供ChatGPT生成式人工智能信息服务,对其依法开展执法约谈,责令立即关停相关服务[2]。

我们理解,对于通过API接口或其他方式直接调用已备案大模型能力的生成式人工智能应用或功能的,相关企业或个人需进行大模型登记,无需进行大模型备案。例如,上海网信主管部门的相关要求为对通过API或其他方式直接调用已备案模型能力,且面向境内公众提供具有舆论属性或者社会动员能力的生成式人工智能服务的,需进行登记工作。对于纯粹面向内部进行部署或使用,并未向公众提供相关生成式人工智能服务应用或功能的,目前暂不需要进行大模型备案或登记工作。

二、数据安全与隐私泄露

生成式人工智能的运行机制高度依赖于数据的持续输入以及用户各类信息的供给。而人工智能基础模型训练可解构为数据准备、数据投喂和机器学习三个阶段[3],每一个步骤都与数据紧密相连。数据的质量优劣以及多样性程度,极大程度地左右着AI大模型生成内容的准确性高低与丰富性程度,但同时也存在着数据侵权风险,因此,用户在部署或使用AI大模型时需要严格遵循《网络安全法》《数据安全法》《个人信息保护法》等相关法律法规,保障数据使用的合规性。

以DeepSeek为例,DeepSeek在其用户协议与隐私政策中均有提及可能会对服务所收集的输入及对应输出用于服务的优化、统计分析、问题排查等。同时,其在《DeepSeek开放平台服务协议》中也提醒开发者应按照《数据安全法》、《个人信息保护法》等法律法规的要求,作为数据处理者、个人信息处理者,承担在收集、处理、使用、存储、删除以及共享终端用户数据(包括个人信息)等活动中的法律责任。

图1 DeepSeek用户协议

图2 DeepSeek隐私政策

与此同时,《生成式人工智能服务管理暂行办法》规定,涉及个人信息的,应当取得个人同意或者符合法律、行政法规规定的其他情形;提供者对使用者的输入信息和使用记录应当依法履行保护义务,不得收集非必要个人信息,不得非法留存能够识别使用者身份的输入信息和使用记录,不得非法向他人提供使用者的输入信息和使用记录。《互联网信息服务深度合成管理规定》规定,深度合成服务提供者应当加强深度合成内容管理,采取技术或者人工方式对深度合成服务使用者的输入数据和合成结果进行审核。深度合成服务提供者和技术支持者应当加强训练数据管理,采取必要措施保障训练数据安全;训练数据包含个人信息的,应当遵守个人信息保护的有关规定。

若用户部署的是国外的AI大模型,数据的跨境流动便难以避免。同理,当国内的大模型走向国际市场时,也必须严格遵循目标国家和地区关于数据流动与个人信息保护的法律法规。例如,以DeepSeek为例,其在出海过程中,就因涉及个人信息等数据相关问题,遭遇了多国的监管挑战。

表2 DeepSeek在国外面临的监管挑战

国家或地区 | 监管措施 |

韩国 | 在DeepSeek的R1大语言模型人工智能聊天机器人推出后,韩国个人信息保护委员会(PIPC)向DeepSeek发出质询函,要求其提供有关收集何种个人数据、数据处理的法律依据以及用户数据是否存储在中国的详细信息。现DeepSeek在韩国已于2025年2月15日从苹果应用商店和谷歌Play商店下架其应用程序[4]。 |

美国 | 美国消费者新闻与商业频道(CNBC)获悉,U.S.Navy基于DeepSeek“来源以及使用的潜在安全与伦理问题”,于2025年1月已指示其成员避免使用中国DeepSeek公司的人工智能技术[5]。1月底,美国参议员Josh Hawley (R-Mo.)提出名为《2025年美国人工智能能力与中国脱钩法案》(Decoupling America’s Artificial Intelligence Capabilities from China Act of 2025)的法案,该法案的核心目的在于切断美国与中国在人工智能等方面的开发、生产等合作交流[6]。 |

欧洲 | (1)2025年2月,法国国家与信息自由委员会(CNIL)与欧洲数据保护委员会(CEPD)成员国就敏感和紧急议题的共同管理展开了交流。在全体会议上,CEPD决定在其专门负责ChatGPT的工作组范围内,纳入有关DeepSeek的调查,并且更广泛地涵盖所有根据《通用数据保护条例》(GDPR)开展的有关人工智能系统的操作性行动[7]。 |

(2)意大利数据保护局于2025年1月28日向DeepSeek的运营主体深度求索公司发送信息索取函,要求相关公司对DeepSeek收集的信息类型、来源、目的、数据存储地址等进行说明,后保护局于1月30日下令限制深度求索公司对意大利用户数据的处理[8]。 |

三、知识产权

企业在部署AI大模型时,知识产权问题需要重点关注,主要涉及以下三个方面:第一,AI大模型本身的知识产权。对于开源的AI大模型,虽然使用本身通常是允许的,但必须严格遵守其许可证规定。DeepSeek采用两类开源许可证,软件代码部分采用的是MIT许可证,一种较为宽松的标准许可证;模型部分则基于OpenRAIL许可证进行修改,形成了自建的开源许可证。同时,DeepSeek在《DeepSeek开放平台服务协议》中明确表示双方在使用本服务之前所拥有的知识产权依然归属各方所有,并且,未经许可,开发者不能擅自使用该产品相关的包括但不限于“深度求索”“DeepSeek”等在内的任何商标、服务标记、商号等显著品牌特征。因此,企业在部署AI大模型时,必须明确相关AI大模型许可证的具体要求,避免因违规使用而引发法律风险,并在与大模型技术服务提供者签订的协议中针对大模型后续使用产生的知识产权归属问题进行约定。第二,内容输入阶段,AI生成应用侵权来源的一大风险问题在于用户将未经授权的内容进行投喂,因此,企业在部署AI大模型后,需对用户的内容输入行为进行约束,避免将未享有知识产权的内容进行商业性目的的投入。第三,生成内容可版权性问题,此问题我们已于《观韬视点|一文详解DeepSeek等大模型AI生成内容相关著作权法律问题及案例》一文中进行了比较详细的探讨,感兴趣的读者可以点击链接进行了解。

四、法律责任

AI大模型在给我们的工作和生活带来便利的同时,也引发了诸多潜在的侵权风险,除了上述提到的法律风险外,还可能存在以下问题:

(1)算法偏见

算法的运行机制往往具有不可见性与不可解释性,在程序设计、数据挖掘、数据分析等诸多环节中,偏见都有可能悄无声息地潜入机器代码,而当算法与用户互动时,它又会不知不觉地习得人类偏见[9]。因此,AI大模型可能会在生成内容中不自觉地展现出带有一定偏见的观点或倾向,进而影响其决策的公正性和客观性。

(2)AI幻觉

此外,AI幻觉对公众造成的认知困扰也是一大问题。AI幻觉通常指“在使用生成式AI模型生成图像、音频、视频等内容时,模型可能会产生看似真实但实际上是虚假的内容”[10]。目前,大部分AI生成应用无法完全保障生成内容的客观性和真实性,而生成的虚假信息一旦被传播很可能会引发信息生态的污染,进而造成公众的信任危机,影响社会稳定。

面对前述的种种法律风险,作为部署或使用AI大模型的用户则可能需要承担相应的法律责任。具体责任的界定需根据不同的使用或部署情形进行综合判断。在此,仅以生成式人工智能服务提供者为例。生成式人工智能服务提供者是指利用生成式人工智能技术提供生成式人工智能服务(包括通过提供可编程接口等方式提供生成式人工智能服务)的组织、个人。若生成式人工智能服务提供者系仅提供AI生成功能技术的中立平台,则其本质上相当于网络服务提供者。尽管从现行网络服务提供者的定义出发——网络服务提供者并非网络运营者,亦非电子商务经营者,可分为网络技术服务提供者(例如提供缓存、链接等技术)与网络内容服务提供者两类[11]——生成式人工智能服务提供者似乎不能被涵盖在内,但笔者认为,随着新技术的不断发展,传统的“网络服务提供者”定义已难以适应新的技术形态,有必要对该定义进行适度的扩张解释,将生成式人工智能服务提供者纳入其中,认定为一种特殊的网络服务提供者,适用于《民法典》等关于网络服务提供者责任的规定。

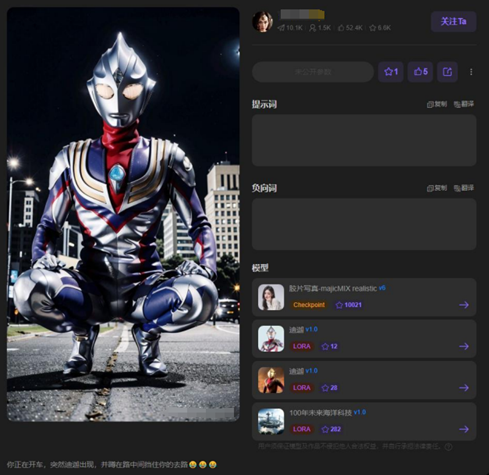

例如,在杭州首例涉生成式人工智能平台侵害信息网络传播权案中,被告运营的某AI平台通过调用SD开源模型,结合平台需求和使用场景进行技术整合和应用部署,完成封装、传输、存储等一系列工程化操作,最终集合成可供用户直接应用的生成式人工智能平台,支持文生图、图生图等在线训练等功能,原告系奥特曼系列形象的知识产权权利人,其认为被告作为生成式人工智能服务提供者,通过输入图片等数据进行训练后生成的方式将侵权图片和侵权模型置于信息网络中,直接侵害了其享有的信息网络传播权。法院认为生成式人工智能服务提供者提供的网络服务有别于传统的网络内容提供行为、网络存储空间服务提供行为和搜索链接服务提供行为等,生成式人工智能服务提供者兼具内容生产者与平台管理者的双重身份,属于一种新型的网络服务。鉴于被告并未参与用户实时的上传、发布、分享图片的行为,主观方面亦缺乏意思联络,不构成直接侵权,但被告未尽到合理注意义务,主观上存在过错,构成帮助侵权[12]。

图3 用户通过某AI平台生成的侵权图片,图源自杭州互联网法院公众号

结语

综上,DeepSeek等各种类型的AI 大模型已在众多领域广泛运用,从政府机关借助其提升政务服务效能,到高校系统利用其革新教学模式,再到商业应用层面通过其创新产品服务,AI 大模型全方位展现出无可估量的发展潜力与价值。然而,技术的两面性也引发了诸多法律和伦理挑战。因此,建议相关主体在使用或部署AI大模型时,严格遵循国家相关法律法规,积极履行合规义务,确保技术应用的合法性与安全性。特别是企业在出于定制化等需求部署AI大模型时,建议咨询相关专业人员,以获取精准指导,从而有效规避潜在风险,实现技术应用效益的最大化。

参考文献

[1] 央视新闻公众号,https://mp.weixin.qq.com/s/TbXivTwFsxIzuOlkLbFNog,访问时间2025-03-04。

[2] 网信重庆公众号, https://mp.weixin.qq.com/s/yr79-J8iuf5O5TGbc1KxWg,访问时间2025-03-04。

[3] 陶乾:《基础模型训练的著作权问题:理论澄清与规则适用》,载《政法论坛》2024年第5期,第153页。

[4] 参见韩国个人信息保护委员会官网,https://www.pipc.go.kr/eng/user/ltn/new/noticeDetail.do,访问时间2025-03-04。

[5] https://www.nbcphiladelphia.com/news/business/money-report/u-s-navy-bans-use-of-deepseek-due-to-security-and-ethical-concerns/4091460/,访问时间2025-03-04。

[6] https://www.hawley.senate.gov/hawley-introduces-legislation-to-decouple-american-ai-development-from-communist-china/,访问时间2025-03-04。

[7] 参见法国国家与信息自由委员会官网,https://www.cnil.fr/fr/coordination-sur-lia-et-protection-des-mineurs-retour-sur-la-derniere-pleniere-du-cepd,访问时间2025-03-04。

[8] 参见意大利数据保护局官网,https://www.garanteprivacy.it/home/docweb/-/docweb-display/docweb/10097450,访问时间2025-03-04。

[9] 郭小平,秦艺轩:《解构智能传播的数据神话:算法偏见的成因与风险治理路径》,载《现代传播》(中国传媒大学学报)2019年第9期,第20-21页。

[10] 郑泉:《生成式人工智能的知识生产与传播范式变革及应对》,载《自然辩证法研究》2024年第3期,第78页。

[11] 程啸:《侵权责任法》(第三版),法律出版社2021年版,第495页。

[12] 上海某文化发展有限公司诉杭州某智能科技有限公司案,杭州互联网法院(2024)浙0192民初1587号民事判决书。